NVIDIA lanzó la CPU NVIDIA Vera, el primer procesador del mundo diseñado específicamente para la era de la IA agente y el aprendizaje por refuerzo, ofreciendo resultados con el doble de eficiencia y un 50% más rápido que las CPUs tradicionales a escala de rack. A medida que avanzan la IA de razonamiento y agentes, la escala, el rendimiento y el coste están cada vez más impulsados por la infraestructura que soporta los modelos que planifican tareas, ejecutan herramientas, interactúan con datos, ejecutan código y validan resultados.

La CPU NVIDIA Vera se basa en el éxito de la NVIDIA Grace, permitiendo a organizaciones de todos los tamaños y sectores construir fábricas de IA que desbloquean IA agente a gran escala. Con el mayor rendimiento en un solo hilo y ancho de banda por núcleo, Vera es una nueva clase de CPU que ofrece mayor rendimiento, capacidad de respuesta y eficiencia de IA para servicios de IA a gran escala como asistentes de programación, así como para agentes de consumo y empresas.

Entre los principales hiperescaladores que colaboran con NVIDIA para desplegar Vera se encuentran Alibaba, CoreWeave, Meta y Oracle Cloud Infrastructure, así como a creadores globales de sistemas como Dell Technologies, HPE, Lenovo, Supermicro y otros. Esta amplia adopción establece a Vera como el nuevo estándar de CPU para las cargas de trabajo de IA que más importan para desarrolladores, startups, instituciones público-privadas y empresas: ayudando a democratizar el acceso a la IA y acelerando la innovación.

«Vera está llegando a un punto de inflexión para la IA. A medida que la inteligencia se vuelve agente —capaz de razonar y actuar—, la importancia de los sistemas que orquestan ese trabajo aumenta en la medida en que los sistemas orquestan ese trabajo», dijo Jensen Huang, fundador y CEO de NVIDIA. «La CPU ya no solo soporta el modelo; Es lo que lo impulsa. Con un rendimiento revolucionario y eficiencia energética, Vera desbloquea sistemas de IA que piensan más rápido y escalan aún más.»

Configurable para cada centro de datos

NVIDIA anunció un nuevo rack de CPU Vera que integra 256 CPUs Vera refrigeradas por líquido para soportar más de 22.500 entornos de CPU simultáneos, cada uno funcionando de forma independiente a pleno rendimiento. Las fábricas de IA pueden desplegarse y escalar rápidamente hasta decenas de miles de instancias simultáneas y herramientas agentes en un solo rack.

El nuevo rack Vera está construido utilizando la arquitectura modular de referencia NVIDIA MGX, soportada por 80 socios del ecosistema en todo el mundo.

Como parte de la plataforma NVIDIA Vera Rubin NVL72, las CPUs Vera se emparejan con GPUs NVIDIA a través de la tecnología de interconexión NVIDIA NVLink-C2C, con 1,8 TB/s de ancho de banda coherente —7 veces el ancho de banda de PCIe Gen 6— para compartir datos a alta velocidad entre CPUs y GPUs. Además, NVIDIA introdujo nuevos diseños de referencia que utilizan a Vera como CPU anfitriona para los sistemas NVIDIA HGX Rubin NVL8, coordinando el movimiento de datos y el control del sistema para cargas de trabajo aceleradas por GPU.

Los socios de sistemas Vera ofrecen configuraciones de servidores de CPU tanto de doble como de un solo socket, óptimas para cargas de trabajo como aprendizaje por refuerzo, inferencia agentica, procesamiento de datos, orquestación, gestión de almacenamiento, aplicaciones en la nube y computación de alto rendimiento (cloud computing).

En todas las configuraciones, los sistemas Vera integran tarjetas NVIDIA ConnectX SuperNIC y DPUs NVIDIA BlueField-4 para redes aceleradas, almacenamiento y seguridad, que son fundamentales para la IA agente. Esto permite a los clientes optimizar para sus cargas de trabajo específicas manteniendo una única pila de software en toda la plataforma NVIDIA.

Diseñado para la escala agente

Al combinar núcleos de CPU de alto rendimiento y eficientes energéticamente, un subsistema de memoria de alto ancho de banda y el NVIDIA Scalable Coherency Fabric de segunda generación, Vera permite respuestas agentes más rápidas bajo las condiciones extremas de utilización comunes en la IA agente y el aprendizaje por refuerzo.

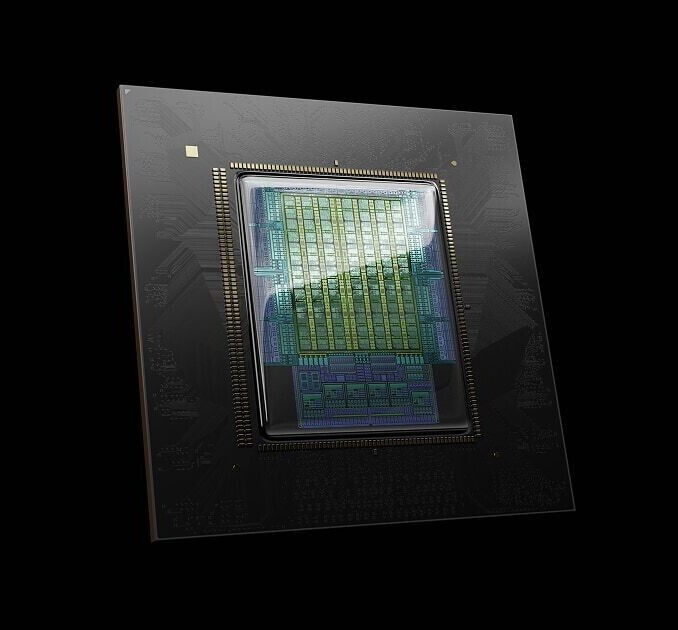

Vera cuenta con 88 núcleos Olympus personalizados diseñados por NVIDIA, ofreciendo un alto rendimiento para compiladores, motores de ejecución, pipelines de análisis, herramientas agentes y servicios de orquestación. Cada núcleo puede ejecutar dos tareas, utilizando NVIDIA Spatial Multithreading, para ofrecer un rendimiento consistente y predecible, ideal para fábricas de IA multi-inquilino que ejecutan muchos trabajos a la vez.

Para mejorar aún más la eficiencia energética, Vera introduce la segunda generación del subsistema de memoria de bajo consumo de NVIDIA, ahora construido sobre memoria LPDDR5X y que ofrece hasta 1,2 TB/s de ancho de banda, el doble de ancho de banda y a la mitad de potencia en comparación con las CPUs de propósito general.

Apoyo generalizado al ecosistema

Cursor, un innovador en el desarrollo de software nativo de IA, está adoptando NVIDIA Vera para mejorar el rendimiento de sus agentes de codificación con IA.

«Estamos entusiasmados de utilizar CPUs NVIDIA Vera para mejorar el rendimiento y la eficiencia generales, de modo que podamos ofrecer experiencias de agentes de codificación más rápidas y responsivas a nuestros clientes», dijo Michael Truell, cofundador y CEO de Cursor.

Redpanda, una plataforma líder en datos de streaming e IA, está utilizando Vera para mejorar drásticamente el rendimiento.

«Redpanda probó recientemente NVIDIA Vera ejecutando cargas de trabajo compatibles con Apache Kafka y obtuvo un rendimiento notablemente mejor que otros sistemas que hemos benchmarkado, ofreciendo hasta 5,5 veces menos latencia», dijo Alex Gallego, fundador y CEO de Redpanda. «Vera representa una nueva dirección en la arquitectura de CPU, con más memoria y menos sobrecarga por núcleo, permitiendo a nuestros clientes escalar las cargas de trabajo de streaming en tiempo real más que nunca y desbloquear nuevas aplicaciones de IA y agentes.»

Los laboratorios nacionales que planean desplegar CPUs Vera incluyen el Centro de Supercomputación Leibniz, el Laboratorio Nacional de Los Álamos, el Centro Nacional de Computación Científica de Investigación en Energía del Laboratorio Nacional Lawrence Berkeley y el Centro de Computación Avanzada de Texas (TACC).

«En TACC, recientemente probamos la plataforma de CPU Vera de NVIDIA mientras nos preparábamos para el despliegue en nuestro próximo sistema Horizon—y ejecutando seis de nuestras aplicaciones científicas, vimos resultados iniciales impresionantes», dijo John Cazes, director de computación de alto rendimiento en TACC. «El rendimiento por núcleo y el ancho de banda de memoria de Vera representan un gran avance para la computación científica, y esperamos llevar nodos basados en Vera a nuestros usuarios de CPU en Horizon a finales de este año.»

Entre los principales proveedores de servicios en la nube que planean desplegar CPUs Vera se encuentran Alibaba, ByteDance, Cloudflare, CoreWeave, Crusoe, Lambda, Nebius, Nscale, Oracle Cloud Infrastructure Together.AI y Vultr.

Los principales proveedores de infraestructura que adoptan CPUs Vera incluyen Aivres, ASRock Rack, ASUS, Compal, Cisco, Dell, Foxconn, GIGABYTE, HPE, Hyve, Inventec, Lenovo, MiTAC, MSI, Pegatron, Quanta Cloud Technology (QCT), Supermicro, Wistron y Wiwynn.