En su presentación MLPerf Inference 6.0, AMD no se limitó a revisitar benchmarks conocidos con una GPU más rápida. Se expandió a cargas de trabajo por primera vez, superó el umbral de 1 millón de tokens por segundo a escala multinodo y demostró que los socios pueden reproducir los resultados en un ecosistema más amplio. Esa combinación es importante porque nuestros clientes ya no evalúan las plataformas de inferencia solo con una métrica. Quieren un rendimiento competitivo en un solo nodo, una escalabilidad eficiente, una puesta en marcha más rápida de nuevos modelos, resultados reproducibles entre sistemas socios y confianza en que la pila de software pueda seguir el ritmo. MLPerf Inference 6.0 nos permitió mostrar todo eso en una sola publicación.

Igualmente importante, demostramos que estos resultados no están aislados. Un amplio ecosistema de socios, presentado a través de cuatro tipos de GPUs AMD Instinct que reproducían de cerca los números enviados por AMD, y la primera presentación heterogénea de MLPerf con tres GPUs, demostró que el hardware de AMD y el software AMD ROCm pueden orquestar un rendimiento de inferencia significativo incluso entre sistemas en diferentes geografías.

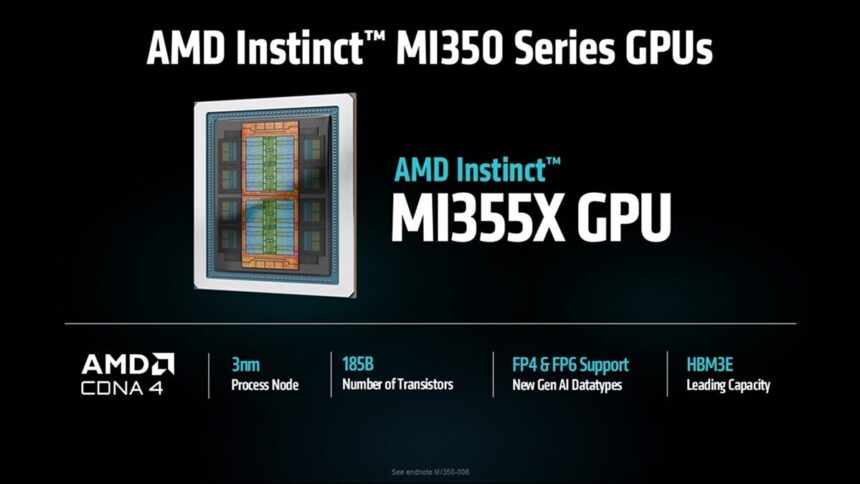

GPUs AMD Instinct MI355X: diseñadas para la inferencia desde cero

Las GPUs AMD Instinct MI355X están construidas sobre arquitectura AMD CDNA 4 con un proceso de 3 nm, incorporan 185.000 millones de transistores, añaden soporte para FP4 y FP6, y combinan todo eso con hasta 288 GB de memoria HBM3E.

Con hasta 10 petaflops de rendimiento FP4 y FP6, soporte para modelos de hasta 520 mil millones de parámetros en una sola GPU y un nodo UBB8 estándar de la industria disponible tanto en configuración refrigerada por aire como refrigerada por líquido directo, las GPUs AMD Instinct MI355X están diseñadas para ofrecer más que velocidad. También están diseñados para ofrecer capacidad de gran modelo y preparación para el despliegue en una sola plataforma.

Momentos definitorios de la presentación AMD MLPerf Inference 6.0

Los resultados de la Inferencia 6.0 de MLPerf de AMD van mucho más allá de un único punto de prueba, revelando avances significativos en rendimiento, cobertura del modelo, escala y reproducibilidad. Destacan varios avances:

1. AMD supera la barrera de 1M tokens/seg en la inferencia MLPerf

Uno de los mayores hitos de esta ronda es que, por primera vez, AMD superó el millón de tokens por segundo en el benchmark MLPerf Inference. AMD superó ese umbral en Llama 2 70B tanto en benchmarks de servidor como offline, y en GPT-OSS-120B en Offline, todo a escala multinodo en GPUs AMD Instinct MI355X.

La industria evalúa cada vez más la inferencia a escala de clúster, donde el rendimiento agregado y el tiempo de servicio determinan si la infraestructura está lista para su despliegue. Superar el millón de tokens por segundo demuestra el rendimiento de inferencia de clase producción.

Para los clientes, este hito tiene beneficios claros:

- Mayor rendimiento agregado para atender grandes poblaciones de usuarios y modelos más grandes.

- Una prueba clara de que las GPUs AMD Instinct MI355X pueden mantener el rendimiento cuando los despliegues van más allá de una sola caja.

- Validación de que cargas de trabajo primerizas como GPT-OSS pueden activarse rápidamente y aún así escalar hacia una producción significativa.

- Una base más sólida para la próxima generación de despliegues de inferencia a escala multinodo y rack.

2. Las GPUs AMD Instinct MI355X ofrecen un salto generacional claro respecto a la generación anterior

AMD también demostró un importante aumento generacional en el servidor Llama 2 70B. La GPU AMD Instinct MI355X entregaba 100.282 tokens por segundo, mostrando un rendimiento 3,1 veces mayor que los resultados previamente presentados de la GPU AMD Instinct MI325X.

Uno de los mayores hitos de esta ronda es que, por primera vez, AMD superó el millón de tokens por segundo en el benchmark MLPerf Inference. AMD superó ese umbral en Llama 2 70B tanto en benchmarks de servidor como offline, y en GPT-OSS-120B en Offline, todo a escala multinodo en GPUs AMD Instinct MI355X.

La industria evalúa cada vez más la inferencia a escala de clúster, donde el rendimiento agregado y el tiempo de servicio determinan si la infraestructura está lista para su despliegue. Superar el millón de tokens por segundo demuestra el rendimiento de inferencia de clase producción.

Eso supone un salto significativo en seis meses, y refleja el poder de la pila completa: arquitectura AMD CDNA 4, alta densidad de cálculo, soporte para FP4 y FP6, gran capacidad de HBM3E y optimizaciones de software AMD ROCm ajustadas para la inferencia moderna de grandes modelos de lenguaje.

3. Llama 2 70B muestra una amplia competitividad en un solo nodo

En Llama 2 70B, el benchmark de modelos de lenguaje grandes más reconocido en MLPerf, la plataforma AMD Instinct MI355X ofreció resultados altamente competitivos en un solo nodo frente a las GPUs NVIDIA B200 y B300. Frente a B200, la plataforma AMD Instinct MI355X se vinculó en Offline, ofreció el 97% del rendimiento del servidor y alcanzó el 119% del rendimiento en benchmarks interactivos. Frente a la plataforma B300 de un solo nodo, la plataforma AMD Instinct MI355X alcanzó el 93% en servidor, el 92% en offline y el 104% en interactivo.

Especialmente importante es la amplitud de los resultados. Esta no es una historia de un solo escenario. AMD muestra competitividad en el rendimiento por lotes en Offline, rendimiento sostenido en Server y capacidad de respuesta en Interactive.

4. GPT-OSS-120B demuestra un modelo rápido a la primera vez

GPT-OSS-120B es una de las partes más emocionantes de esta entrega de Inferencia 6.0 porque fue una carga de trabajo ejecutada en MLPerf por primera vez. La habilitación por primera vez del modelo es difícil: el modelo debe ser activado, optimizado, validado para su precisión y llevado a un rendimiento competitivo dentro del timing de MLPerf.

A pesar de esa complejidad, la plataforma AMD Instinct MI355X ofrecía el 111% del rendimiento B200 Offline y el 115% del rendimiento de un solo nodo del servidor B200 de NVIDIA. Frente a NVIDIA B300 de un solo nodo, la plataforma AMD Instinct MI355X alcanzó un 91% competitivo en Offline y un 82% en Servidor.

5. Wan-2.2-t2v extiende AMD hacia una inferencia completamente nueva de texto a vídeo

MLPerf Inference 6.0 también permitió a AMD expandirse más allá de los grandes modelos de lenguaje (LLM) hacia la generación texto a vídeo con una primera presentación en Wan-2.2-t2v. Este benchmark tiene dos pruebas: Offline y Single Stream. Para esta entrega centramos nuestro esfuerzo en el escenario de Flujo Único y, como resultado, nuestra propuesta está en la categoría Abierta en lugar de Cerrada (que requiere tanto Offline como Flujo Único). Sin embargo, nuestra carrera en Single Stream sí cumplió las reglas de envío cerrado y, por tanto, puede compararse directamente con las puntuaciones de la división cerrada.

Aun así, el resultado es impresionante para un primer esfuerzo de AMD en una categoría de carga de trabajo completamente nueva: la plataforma AMD Instinct MI355X logró el 93% del rendimiento NVIDIA B200 en un solo nodo y el 87% del rendimiento en un solo nodo del NVIDIA B300 en Single Stream. Tras la fecha límite, un ajuste adicional llevó a Single Stream al 108% de B200 y a paridad con B300, mientras que los resultados no oficiales de Offline alcanzaron el 111% de B200 y el 88% de B300. Las cifras posteriores a la fecha límite no formaban parte de la presentación oficial de MLPerf ni fueron verificadas por MLCommons, pero muestran claramente lo rápido que mejoró el rendimiento una vez que tuvimos más tiempo para ajustar.

Para los clientes, la importancia de este resultado va más allá de los propios porcentajes. Demuestra que AMD está ampliando la cobertura de modelos desde los LLMs hacia cargas de trabajo multimodales y generativas de vídeo más recientes, y lo hace con un rendimiento competitivo desde el primer día.

Eso importa porque la IA generativa no está quieta. Los modelos que los clientes quieren desplegar se están volviendo más amplios, multimodales, más especializados, y AMD está demostrando que puede mantenerse al día.

6. La inferencia multinodo muestra un escalamiento eficiente

El interés por la inferencia multinodo está en aumento a medida que los modelos crecen, los despliegues se vuelven más exigentes y la industria sienta las bases para sistemas a escala de rack como la solución AMD Helios. Nuestra presentación MLPerf Inference 6.0 muestra que el AMD Instinct MI355X está listo para esa transición.

En Llama 2 70B, escalamos de un nodo a 11 nodos y nos mantuvimos sorprendentemente cerca de la escala lineal ideal.

Con 11 nodos y 87 GPUs AMD Instinct MI355X, entregamos 1.042.110 tokens por segundo en Offline, 1.016.380 tokens por segundo en Server y 785.522 tokens por segundo en Interactive. La eficiencia de escalabilidad alcanzó el 93% en Offline, 93% en Servidor y 98% en Interactivo. La escalabilidad offline es el camino más estándar, pero Server e Interactive son más difíciles porque deben cumplir los requisitos de latencia a medida que crece el clúster, lo que hace que estos resultados sean especialmente atractivos.

Este es exactamente el tipo de trampolín que necesitamos a medida que la inferencia avanza hacia AMD Helios y futuros despliegues a escala de rack.Los

resultados multinodo continúan en GPT-OSS-120B. Estos resultados se vuelven aún más interesantes ya que esta fue nuestra primera presentación multinodo GPT-OSS. La cuestión no era solo si podíamos habilitar el modelo, sino si podríamos escalarlo eficientemente a través de un clúster real. Con 12 nodos y 94 GPUs AMD Instinct MI355X, entregamos 1.031.070 tokens por segundo en Offline y 900.054 tokens por segundo en Server. Igualmente importante, nos mantuvimos cerca de la escala ideal de 12x, con un 92% de eficiencia en Offline y un 93% en Servidor. Eso convirtió a GPT-OSS en el segundo modelo en el que superamos la marca del millón de tokens por segundo a escala multinodo.

Para los clientes, estos resultados escalados proporcionan puntos de prueba importantes:

- La escalada multinodo predecible hace crecer los clústeres de inferencia sin perder eficiencia a medida que aumentan las cargas de trabajo y el tamaño del modelo.

- Una alta eficiencia a escala de servidor genera confianza para la inferencia en tiempo real, no solo para el procesamiento por lotes de alto rendimiento.

- Una mayor eficiencia en la escalabilidad mejora la utilización de la GPU, ayudando a reducir el coste por token y maximizando la inversión en infraestructura.

- El rendimiento multinodo probado ofrece a los clientes un camino más sólido desde despliegues piloto hasta infraestructuras de IA a escala de producción

Escala del ecosistema y reproducibilidad entre las propuestas de socios

Otro punto destacado para AMD en la presentación de MLPerf Inference 6.0 es el impulso del ecosistema. Esta ronda resultó en un empate con el número de socios que enviaron en hardware AMD Instinct con nueve: Cisco, Dell, Giga Computing, HPE, MangoBoost, MiTAC, Oracle, Supermicro y Red Hat.

Esas propuestas abarcaban cuatro tipos de GPU AMD Instinct: MI300X, MI325X, MI350X y MI355X. Demuestra que el ecosistema no está limitado a una configuración insignia; abarca múltiples generaciones y múltiples modelos de despliegue en plataformas OEM, ODM y de estilo cloud.

Esta reproducibilidad es especialmente poderosa. En las GPUs AMD Instinct MI355X, los resultados de los socios se situaron dentro del 4% de la presentación realizada por AMD, y algunos dentro del 1%, incluso en cargas de trabajo ejecutadas por primera vez. Eso es una señal muy clara de que estos números no son artefactos frágiles de laboratorio; son reproducibles en sistemas socios reales gracias al hardware predecible de AMD y al software AMD ROCm.

Para los clientes, eso significa más que la elección. Significa confianza en que el rendimiento que demuestra AMD puede recrearse en todo el ecosistema, reduciendo el riesgo de despliegue y acelerando el tiempo hasta la producción.

La primera presentación heterogénea de 3 GPUs demuestra una inferencia flexible entre geografías

Uno de los resultados más visionarios es la primera presentación heterogénea MLPerf construida en tres tipos de GPU AMD Instinct: MI300X, MI325X y MI355X. Enviada por Dell y MangoBoost, la configuración alcanzó 141.521 tokens por segundo en el servidor Llama 2 70B y 151.843 tokens por segundo en Llama 2 70B Offline.

Un detalle especialmente importante es la geografía. La plataforma AMD Instinct MI355X estaba ubicada en el laboratorio de Dell en Estados Unidos, mientras que las plataformas Instinct MI300X y MI325X estaban en Corea. Eso hace que esto sea más que una historia de inferencia mixta, también es un punto de prueba para la orquestación entre sistemas de diferentes geografías.

Para los clientes, el valor es evidente:

- Los despliegues existentes de la GPU AMD Instinct pueden ampliarse en lugar de ser eliminados y reemplazados.

- El hardware de generación mixta puede orquestarse de forma inteligente para preservar la utilización y el rendimiento.

- El software AMD ROCm ayuda a que los entornos no uniformes sean más prácticos, predecibles y rentables.

- AMD está demostrando un camino hacia una infraestructura flexible y preparada para el futuro en lugar de ciclos de actualización de un solo momento.

Cómo el software AMD ROCm impulsa el rendimiento, la escala y la habilitación del modelo

Cada resultado importante en la presentación de la Inferencia 6.0 de AMD MLPerf está conectado por un hilo común: el software AMD ROCm. Convirtió el hardware AMD Instinct MI355X en una plataforma desplegable para inferencia competitiva de una sola GPU, rendimiento a escala de clúster, orquestación heterogénea y puesta en marcha por primera vez de modelos.

En la presentación, el software AMD ROCm ayudó a permitir una ejecución eficiente de FP4, una comunicación optimizada GPU a GPU para escalar multinodos, una distribución dinámica de cargas de trabajo para inferencias heterogéneas y una preparación de modelos para el día cero en modelos como Llama, Wan y GPT-OSS.

Para los clientes, el software AMD ROCm ofrece varias ventajas prácticas:

- Rendimiento optimizado del modelo para tipos de datos modernos de IA generativa y núcleos de inferencia.

- Escalabilidad multinodo fluida con comunicación y orquestación eficientes.

- Distribución heterogénea de la carga de trabajo entre generaciones de GPUs AMD Instinct.

- Preparación más rápida para modelos emergentes y nuevas categorías de carga de trabajo.

Por eso el software ROCm es una parte tan importante de la historia de AMD. No solo ayuda a AMD a conseguir un resultado sólido en benchmark, sino que permite rendimiento, escalabilidad, flexibilidad y reproducibilidad en toda la cartera de Instinct.

Annual Cadence se está preparando hacia las soluciones AMD Instinct MI400 Series y Helios Rack-Scale

El contexto más amplio detrás de estos resultados es el impulso. AMD está ejecutando una cadencia anual para las GPUs Instinct, y esa consistencia importa. Las GPUs AMD Instinct MI300X establecieron una sólida base en IA generativa en 2023. Las GPUs AMD Instinct MI325X ampliaron esa base en 2024 con mayor capacidad de cálculo y HBM3E. En 2025, la serie AMD Instinct MI350, incluida la GPU MI355X, impulsó la plataforma de nuevo con nuevos tipos de datos de IA, mayor capacidad de modelos y las mejoras de inferencia mostradas a lo largo de esta presentación.

Y en 2026, AMD planea avanzar a las GPUs AMD Instinct MI400 Series basadas en la arquitectura AMD CDNA 5 de próxima generación, extendiendo esta cadencia anual a la próxima era de la IA a escala de rack y sentando las bases para la solución AMD Helios a escala de rack. Para los clientes, eso proporciona confianza en que AMD no solo está entregando un resultado sólido hoy, sino que está construyendo una plataforma de inferencia a largo plazo que puede escalar con el tamaño del modelo, la diversidad de carga de trabajo y los requisitos de despliegue en producción.

Conclusión final

La presentación de AMD MLPerf Inference 6.0 supone un gran avance para AMD y su historia de IA generativa. En cargas de trabajo completamente nuevas, las GPUs AMD Instinct MI355X ofrecieron resultados altamente competitivos en un solo nodo, un rendimiento escalable multinodo increíblemente eficiente, una puesta en marcha por primera vez en GPT-OSS-120B y Wan-2.2-t2v, y un hito de entregar más de 1 millón de tokens por segundo a escala de clúster.

En el centro de todo esto está el software AMD ROCm y una disciplina anual de hoja de ruta. Desde la GPU AMD Instinct MI300X hasta la GPU MI325X y la serie MI350 con la GPU AMD Instinct MI355X, AMD avanza rápidamente, ampliando el soporte de modelos y construyendo la base de software y sistemas necesaria para futuros despliegues de IA a escala de rack. Con la solución AMD Helios a escala de rack impulsada por la serie AMD Instinct MI400 y futuras generaciones de AMD Instinct en el horizonte, MLPerf Inference 6.0 refuerza un mensaje claro: AMD no solo participa en la transición de la inferencia generativa de IA, sino que ayuda a definir cómo es la infraestructura GenAI lista para producción.

Para los lectores interesados en la historia técnica más profunda detrás de estos resultados, dos nuevos blogs de AMD ROCm ofrecen detalles adicionales sobre la presentación de MLPerf Inference v6.0. «AMD Instinct GPUs MLPerf Inference v6.0 Submission» explora el trabajo de hardware y software detrás de estos resultados, mientras que «Reproducing the AMD MLPerf Inference v6.0 submission result» explica cómo replicar los benchmarks en hardware AMD Instinct, reforzando el compromiso de AMD con la apertura, transparencia y reproducibilidad en la inferencia de IA.