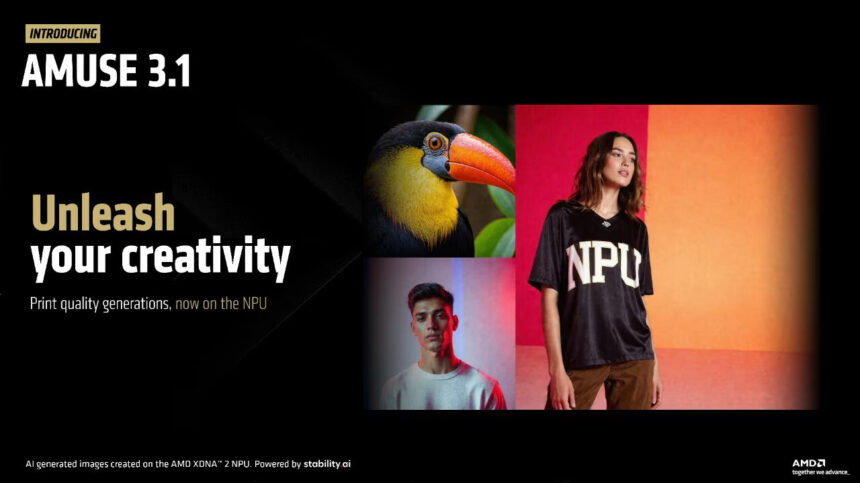

AMD y Stability AI han anunciado su esfuerzo conjunto para adaptar Stable Diffusion 3.0 Medium para el creador de arte Stability Amuse AI. Este movimiento permite una mejor generación de imágenes y capacidades de manejo de texto para ejecutarse en unidades de procesamiento neuronal (NPU). Anteriormente, en Computex 2024, AMD mostró el primer modelo de difusión estable de bloques FP16 del mundo, SDXL Turbo, que crearon con Stability AI. Este nuevo modelo alcanzó la precisión FP16 en los niveles de rendimiento INT8. Las dos compañías presentan ahora su nuevo trabajo en equipo con el primer bloque FP16 SD 3.0 Medium. Este paso adelante brinda una mayor calidad de imagen al tiempo que se adapta a las NPU AMD Ryzen AI XDNA 2. Las personas pueden usar esto de inmediato a través de Amuse 3.1 de Tensorstack que se ejecuta en modo HQ en computadoras portátiles con Ryzen AI que lo admiten.

El nuevo modelo bloque FP16 SD 3 Medium necesita menos memoria que las versiones anteriores, ya que funciona en portátiles de 24 GB y utiliza hasta 9 GB de memoria. Este tipo de datos permite la generación de imágenes de IA local de alta calidad en portátiles con menos de 32 GB de memoria utilizando un formato de alta precisión sin cuantificación excesiva. El sistema incorpora una tubería de dos etapas impulsada por la NPU AMD XDNA 2 que mejora las imágenes de salida estándar de 2 megapíxeles (1024 x 1024) a una resolución de 4 megapíxeles (2048 x 2048). En el pasado, Amuse ofrecía Stable Diffusion Medium, pero necesitaba procesamiento de GPU, lo que frenaba su uso generalizado. Ahora, los usuarios pueden elegir entre el procesamiento de GPU o NPU. Para probar esta nueva función, los usuarios deben descargar e instalar el último controlador Adrenalin, luego Amuse 3.1 Beta y, mientras están en modo EZ, mover el control deslizante a HQ y alternar XDNA 2 Stable Diffusion Offload.